Projekt Künstliche Intelligenz

SoSe 2026

Übersicht

WarmUp: Ki-TandemLab- Didaktisches Arbeiten mit KI

- Machine Learning

- Aktuelle KI-Landschaft & Modelle

- Academic Cloud

- Prompting & Craft Framework

Overview

Warm-up: AI Tandem Lab- Didactic Work with AI

- Machine Learning

- Current AI Landscape & Models

- Academic Cloud

- Prompting & CRAFT Framework

WarmUp: KI-TandemLab

Bilder mit KI analysieren und Ergebnisse austauschen

Bild mit KI-Tool analysieren & nachfragen

Erkenntnisse austauschen

Warm-up: AI Tandem Lab

Analyze images with AI and share findings

Analyze image with AI tool & ask follow-ups

Share results and insights

Ablauf

Warten auf alle

Bild mit KI analysieren, nachfragen & mit Zweitquelle prüfen

Ergebnisse austauschen (2,5 min pro Person)

Process

Wait for everyone

Analyze image with AI, ask follow-ups & verify with second source

Share results (2.5 min per person)

Heutige Session

Quelle: watson.ch

Today's Session

Source: watson.ch

Didaktisches Arbeiten mit KI

- Wer mit KI arbeiten will, muss verstehen, wie KI arbeitet und wie Entscheidungen entstehen.

- KI ist kein „denkendes Wesen", sondern ein technisches System

- Verstehen schafft Vertrauen und Kritikfähigkeit

Didactic Work with AI

- Anyone who wants to work with AI must understand how AI works and how decisions are made.

- AI is not a "thinking being", but a technical system

- Understanding builds trust and critical thinking

Wie trifft KI Entscheidungen?

- KI trifft keine bewussten oder moralischen Entscheidungen

- Entscheidungen entstehen rechnerisch aus:

- Trainingsdaten

- Merkmalen (Features)

- Modellen & Wahrscheinlichkeiten

- Gleiche Eingaben → gleiche Ausgaben (deterministisch)

How Does AI Make Decisions?

- AI does not make conscious or moral decisions

- Decisions are computed based on:

- training data

- features

- models & probabilities

- Same input → same output (deterministic)

Grenzen & Verzerrungen

- KI kann nur lernen, was in den Daten enthalten ist

- Fehler und Verzerrungen entstehen durch:

- unvollständige oder einseitige Daten

- vereinfachte Modelle

- falsche Annahmen

- KI kann plausible, aber falsche Ergebnisse liefern

Limits & Biases

- AI can only learn what is contained in the data

- Errors and biases arise from:

- incomplete or biased data

- simplified models

- false assumptions

- AI may produce plausible but incorrect results

Didaktisches Ziel

- KI nicht nur anwenden, sondern durchschauen

- Entscheidungsprozesse erklären können

- Ergebnisse reflektieren und hinterfragen

- Grundlagen für verantwortungsvollen KI-Einsatz

Didactic Goal

- Not just using AI, but understanding it

- Being able to explain decision processes

- Reflecting on and questioning results

- Foundations for responsible AI use

Einstieg in KI-Verständnis

- Klassifikation als niedrigschwelliger Einstieg

- Eigene Trainingsdaten erstellen & verändern

- Zusammenhang zwischen Daten und Entscheidungen erkennen

- Direkte Rückmeldung durch Modellverhalten

Entry into Understanding AI

- Classification as a low-threshold entry point

- Creating and modifying training data

- Recognizing the link between data and decisions

- Immediate feedback through model behavior

Machine Learning

Algorithmen lernen aus Daten, um Muster zu erkennen und Vorhersagen zu treffen.

Überwachtes Lernen

Lernt aus gelabelten Daten

Klassifikation

Kategorien zuordnen

Regression

Werte vorhersagen

Unüberwachtes Lernen

Findet Muster in ungelabelten Daten

Clustering

Ähnliche Daten gruppieren

Machine Learning

Algorithms learn from data to recognize patterns and make predictions.

Supervised Learning

Learns from labeled data

Classification

Assign categories

Regression

Predict values

Unsupervised Learning

Finds patterns in unlabeled data

Clustering

Group similar data

Überwachtes Lernen

Modell lernt aus gelabelten Daten (Eingabe → erwartete Ausgabe)

Klassifikation

Ordnet Daten in Kategorien ein

- Spam / kein Spam

- Bild: Katze / Hund

- Krankheit: ja / nein

Regression

Sagt kontinuierliche Werte voraus

- Hauspreis

- Temperatur morgen

- Aktienkurs

Supervised Learning

Model learns from labeled data (input → expected output)

Classification

Assigns data to categories

- Spam / not spam

- Image: cat / dog

- Disease: yes / no

Regression

Predicts continuous values

- House price

- Tomorrow's temperature

- Stock price

Unüberwachtes Lernen

Modell findet selbstständig Muster in ungelabelten Daten

Clustering

Gruppiert ähnliche Datenpunkte in Cluster

- Kundensegmentierung

- Themengruppen in Texten

- Anomalie-Erkennung

Unsupervised Learning

Model independently finds patterns in unlabeled data

Clustering

Groups similar data points into clusters

- Customer segmentation

- Topic groups in texts

- Anomaly detection

Aufgabe: Machine Learning – Einstieg (ca. 15-20min)

Code.org – Oceans: Machine Learning

- Erste Einführung in Programmierung & Informatik

- Klassifikation von Objekten (z. B. „Fisch" / „kein Fisch")

- Umgang mit Trainingsdaten (Datensatz erweitern)

- Eigene Beschriftungen für Bilder festlegen

- ML-Modell lernt aus Beispielen

- Modell beschriftet neue Bilder selbstständig

- Spielerischer, sicherer Lernkontext

Task: Machine Learning – Introduction (approx. 15–20 min)

Code.org – Oceans: Machine Learning

- First introduction to programming & computer science

- Classification of objects (e.g. "fish" / "not fish")

- Working with training data (extending datasets)

- Defining your own labels for images

- ML model learns from examples

- Model labels new images independently

- Playful, safe learning environment

Aktuelle KI-Landschaft

KI entwickelt sich rasant weiter — drei zentrale Entwicklungen bestimmen 2026:

GPT-5.4, Claude Opus 4.6, Gemini 3.1 Pro — immer leistungsfähiger, multimodal, riesige Kontextfenster.

Llama 3.3, Mistral Small 3, Qwen 3, DeepSeek V3.2 — lokal betreibbar, transparent, ohne Cloud-Abhängigkeit.

Modelle werden gezielt optimiert: Code-Generierung, Vision, mathematisches Reasoning, Agenten.

Current AI Landscape

AI is evolving rapidly — three key developments define 2026:

GPT-5.4, Claude Opus 4.6, Gemini 3.1 Pro — increasingly capable, multimodal, huge context windows.

Llama 3.3, Mistral Small 3, Qwen 3, DeepSeek V3.2 — run locally, transparent, no cloud dependency.

Models are purpose-built: code generation, vision, mathematical reasoning, agents.

Skalierung am Limit?

Die Debatte: Wird KI immer besser — oder stagniert der Fortschritt?

- Skalierungsgesetze zeigen abnehmende Erträge

- Trainingsdaten sind endlich — es gibt nur ein Internet

- Frontier-Modelle seit >1 Jahr an einer Benchmark-Decke

- Nicht "alles gelesen" ist das Limit, sondern:

- Hardware: TSMC 5nm/3nm ausgebucht

- Energie: Power Wall — Rechenzentren brauchen Gigawatt

- Neues Paradigma: Inference-Time Compute — Modelle wie o1/o3 denken länger nach statt mehr Daten zu schlucken

Scaling at its Limits?

The debate: Is AI getting ever better — or is progress stalling?

- Scaling laws show diminishing returns

- Training data is finite — there's only one internet

- Frontier models have hit a benchmark ceiling for >1 year

- It's not "read everything" but rather:

- Hardware: TSMC 5nm/3nm fully booked

- Energy: Power wall — data centers need gigawatts

- New paradigm: Inference-Time Compute — models like o1/o3 think longer instead of consuming more data

KI-Modelle im Überblick (Stand: April 2026)

Gehostet (Cloud)

| Modell | Anbieter | Stärken |

|---|---|---|

| GPT-5.4 Pro | OpenAI | Allrounder, größtes Ökosystem |

| Claude Opus 4.6 | Anthropic | Code, Reasoning, lange Kontexte |

| Gemini 3.1 Pro | Reasoning-Leader, multimodal | |

| DeepSeek V3.2 | DeepSeek | ~90% GPT-5 Leistung, 1/50 Preis |

| Grok 4 | xAI | Code, Echtzeit-Daten |

Lokal hostbar (Open Weights)

| Modell | RAM | VRAM | Disk | Stärken |

|---|---|---|---|---|

| Llama 3.3 8B | 16 GB (32) | 8 GB (12) | ~5 GB | Bester Allrounder |

| Mistral Small 3 | 16 GB (32) | 7 GB (12) | ~4 GB | Schnell, mehrsprachig |

| Phi-4 14B | 16 GB (32) | 10 GB (16) | ~8 GB | Reasoning, beste Leistung/GB |

| Gemma 3 27B | 32 GB (48) | 16 GB (24) | ~16 GB | Instruction-following |

| Qwen 3 32B | 32 GB (64) | 16 GB (24) | ~19 GB | Sweet Spot Leistung/Ressourcen |

| Llama 3.3 70B | 64 GB (128) | 42 GB (80) | ~40 GB | Frontier-Niveau, 2–4x A100 |

Min. (flüssig/Echtzeit) — INT4 Quantisierung

AI Models Overview (as of April 2026)

Hosted (Cloud)

| Model | Provider | Strengths |

|---|---|---|

| GPT-5.4 Pro | OpenAI | All-rounder, largest ecosystem |

| Claude Opus 4.6 | Anthropic | Code, reasoning, long contexts |

| Gemini 3.1 Pro | Reasoning leader, multimodal | |

| DeepSeek V3.2 | DeepSeek | ~90% GPT-5 performance, 1/50 price |

| Grok 4 | xAI | Code, real-time data |

Self-hostable (Open Weights)

| Model | RAM | VRAM | Disk | Strengths |

|---|---|---|---|---|

| Llama 3.3 8B | 16 GB (32) | 8 GB (12) | ~5 GB | Best all-rounder |

| Mistral Small 3 | 16 GB (32) | 7 GB (12) | ~4 GB | Fast, multilingual |

| Phi-4 14B | 16 GB (32) | 10 GB (16) | ~8 GB | Reasoning, best perf/GB |

| Gemma 3 27B | 32 GB (48) | 16 GB (24) | ~16 GB | Instruction-following |

| Qwen 3 32B | 32 GB (64) | 16 GB (24) | ~19 GB | Best performance/resource |

| Llama 3.3 70B | 64 GB (128) | 42 GB (80) | ~40 GB | Frontier-level, 2–4x A100 |

Min. (smooth/real-time) — INT4 quantization

Academic Cloud

KI-Modelle datenschutzkonform testen — kostenlos mit PH-Account.

- Login mit PH-Account (SSO)

- Deutscher Betrieb — DSGVO-konform

- Keine Nutzung der Eingaben zum Training

- PH-KI-Richtlinie beachten (auf PH-Website verfügbar)

- Verschiedene Modelle zum Testen (GPT-4o, Claude, Llama u.a.)

- Chat-Interface im Browser

- Ideal zum Vergleichen von Modellen

- Gut geeignet für Lehre und Forschung

Academic Cloud

Test AI models with full data privacy — free with your university account.

- Login with university account (SSO)

- Operated in Germany — GDPR-compliant

- Your inputs are not used for training

- Follow the university's AI policy (available on PH website)

- Multiple models to try (GPT-4o, Claude, Llama, etc.)

- Browser-based chat interface

- Great for comparing models side by side

- Well suited for teaching and research

Aufgabe: KI-Modelle vergleichen

Gleiche Prompts, verschiedene Modelle — Unterschiede verstehen (ca. 15 min)

1. Academic Cloud öffnen

- Mit PH-Account anmelden

- academiccloud.de → ChatAI

- Modell auswählen

2. Vergleichen & Testen

- Gleichen Prompt an 2–3 Modelle

- Systemprompt verändern (z.B. „Erkläre für Anfänger“)

- Parameter testen: Temperatur (kreativ ↔ logisch), Top-p (vielfältig ↔ fokussiert)

3. Reflektieren

- Welches Modell war am hilfreichsten?

- Welche Einstellungen funktionierten?

- Was sagt das über KI-Entscheidungen?

Erkläre „Maschinelles Lernen“: Grundidee, Trainingsdaten, Beispiel Klassifikation, typische Grenzen

Task: Compare AI Models

Same prompts, different models — understand the differences (approx. 15 min)

1. Open Academic Cloud

- Sign in with PH account

- academiccloud.de → ChatAI

- Select a model

2. Compare & Test

- Same prompt to 2–3 models

- Change system prompt (e.g. “Explain for beginners”)

- Test parameters: Temperature (creative ↔ logical), Top-p (diverse ↔ focused)

3. Reflect

- Which model was most helpful?

- Which settings worked best?

- What does this tell us about AI decisions?

Explain "Machine Learning": core idea, training data, classification example, typical limitations

Häufiges Problem: Ungenaues Prompting

- Unklare Aufgaben → unklare Antworten

- KI muss Annahmen treffen (Ziel, Niveau, Format)

- Ergebnisse oft:

- zu allgemein

- am Thema vorbei

- uneinheitlich oder schwer vergleichbar

- Fehlende Steuerung von Fokus, Tiefe und Ton

- Problem liegt meist nicht bei der KI, sondern beim Prompt

Common Problem: Vague Prompting

- Unclear tasks → unclear answers

- AI has to make assumptions (goal, level, format)

- Results are often:

- too general

- off-topic

- inconsistent or hard to compare

- Lack of control over focus, depth and tone

- The problem is usually not the AI, but the prompt

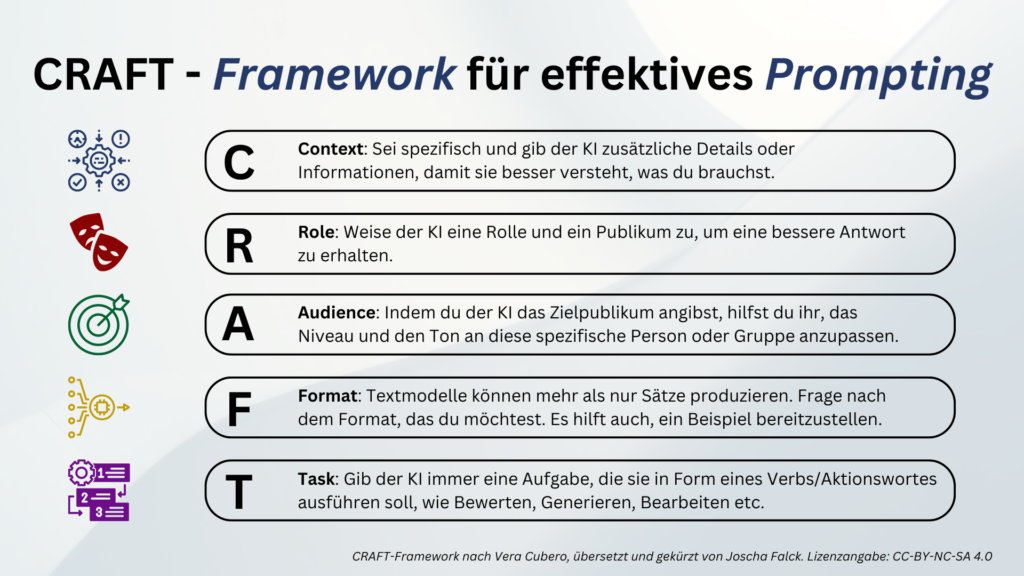

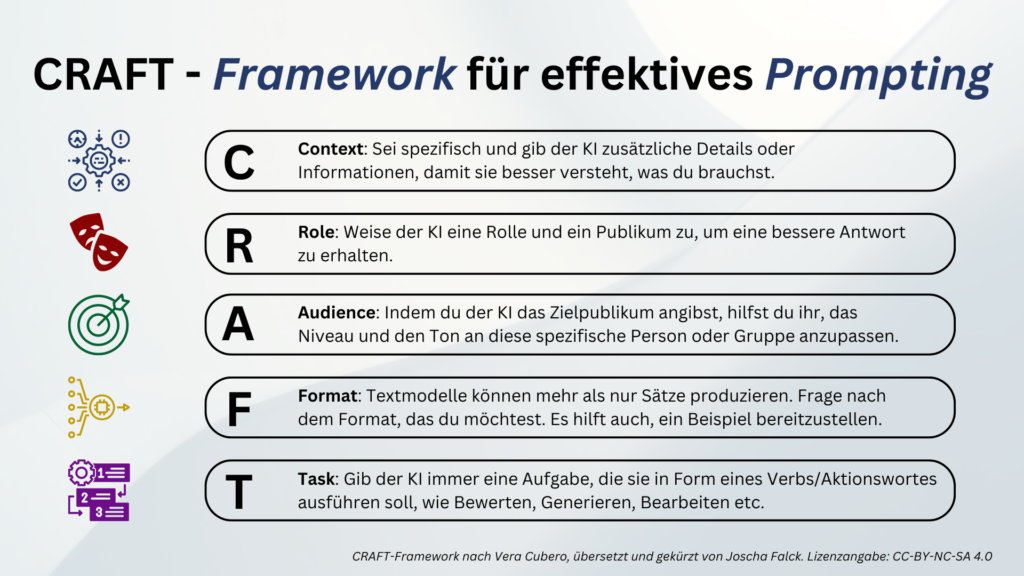

Prompting mit dem CRAFT-Framework

Grundlage: https://kreidezeit.kiwi/gpt/craft.html

- Ziel: Den gleichen Inhalt durch besseres Prompting gezielter steuern

- Vergleich: „freier Prompt" vs. „CRAFT-strukturierter Prompt"

- Vergleichen Sie die Antwort mit einem nicht strukturierten Prompt

- Beobachten Sie Klarheit, Struktur und Zielgenauigkeit

Prompting with the CRAFT Framework

Source: https://kreidezeit.kiwi/gpt/craft.html

- Goal: Steering the same content more precisely through better prompting

- Comparison: "free prompt" vs. "CRAFT-structured prompt"

- Compare responses with an unstructured prompt

- Observe clarity, structure and target accuracy

Ausblick: Weltmodelle

Von Textvorhersage zu echtem Verständnis?

GenAI (GPT, Claude, ...)

Sagt das nächste Token voraus. „Remixt“ vorhandenes Wissen. Keine Kausalität.

Weltmodelle (Yann LeCun / AMI Labs)

Lernen aus Videos & Messdaten. Simulieren physikalische Realität. Verstehen Ursache & Wirkung.

- Kausalität: Wind → Gegenstand fällt (nicht nur Korrelation)

- Training: Videos, Temperatur, Feuchtigkeit statt Textkorpora

- Ziel: Interne Simulation der Welt → Weg zu AGI?

Quelle: unidigital.news

Outlook: World Models

From text prediction to true understanding?

GenAI (GPT, Claude, ...)

Predicts the next token. Remixes existing knowledge. No causality.

World Models (Yann LeCun / AMI Labs)

Learn from videos & measurements. Simulate physical reality. Understand cause & effect.

- Causality: Wind → object falls (not just correlation)

- Training: Videos, temperature, humidity instead of text corpora

- Goal: Internal simulation of the world → path to AGI?

Source: unidigital.news

Ziel dieser Veranstaltung

Praktische Erfahrung

Innerhalb eines eigenen Projekts mit KI-Integration praktische Erfahrungen sammeln.

Dokumentation auf Git

Erfahrungen und Wissen in einem eigenen Git-Repository dokumentieren — neues Repo auf git.md-phw.de

Offene Gestaltung

Thema frei wählbar nach Ihrem Interesse. Kein Schulkontext nötig.

Inputs & Support

Fachliche Inputs und Begleitung von uns. Projekte gerne in Zusammenarbeit oder als Integration in bestehende Projekte.

Goal of this Course

Hands-on Experience

Gain practical experience within your own project with AI integration.

Documentation on Git

Document your experiences and knowledge in your own Git repository — new repo on git.md-phw.de

Open Design

Topic freely chosen based on your interests. No school context required.

Inputs & Support

Expert input and guidance from us. Projects welcome in collaboration or as integration into existing projects.